OpenWebUI

OpenWebUI est une interface web connectée à des modèles d'IA via Ollama, déployée ici dans un cluster Kubernetes à l'aide de FluxCD et Helm.

Présentation

Ce dossier contient la configuration déclarative de l’application OpenWebUI, déployée via FluxCD :

Installation

Namespace

Le fichier namespace.yaml crée le namespace openwebui:

HelmRepository

Le fichier helmrepo.yaml référence le dépôt Helm contenant le chart OpenWebUI :

HelmRelease

Le fichier helmrelease.yaml contient la définition complète du déploiement Helm :

Accès à l'interface

Une fois le déploiement effectué et l'ingress configuré, l'application sera accessible à l'adresse suivante :

📍 https://ia.innovalia.cc

Fonctionnalités désactivées

Dans cette configuration :

L'API OpenAI est désactivée (

enableOpenaiApi: false)L'intégration directe d’Ollama est désactivée (

ollama.enabled: false)Les pipelines sont désactivés (

pipelines.enabled: false)

Cela permet un déploiement léger pour des besoins spécifiques.

Connection à notre serveur Ollama local

Nous pouvons nous "provisionner" la connection à notre serveur local directement dans la configuration (ollamaUrls:)

TLS avec Traefik

La configuration TLS repose sur les annotations suivantes dans l'Ingress :

Certificat généré via

myresolverEntrypoint sécurisé

websecureForçage du protocole

httpsvia l'en-têteX-Forwarded-Proto

Mise à jour automatique

Le champ interval: 5m permet à FluxCD de vérifier toutes les 5 minutes la présence d'une nouvelle version du chart.

Utilisation

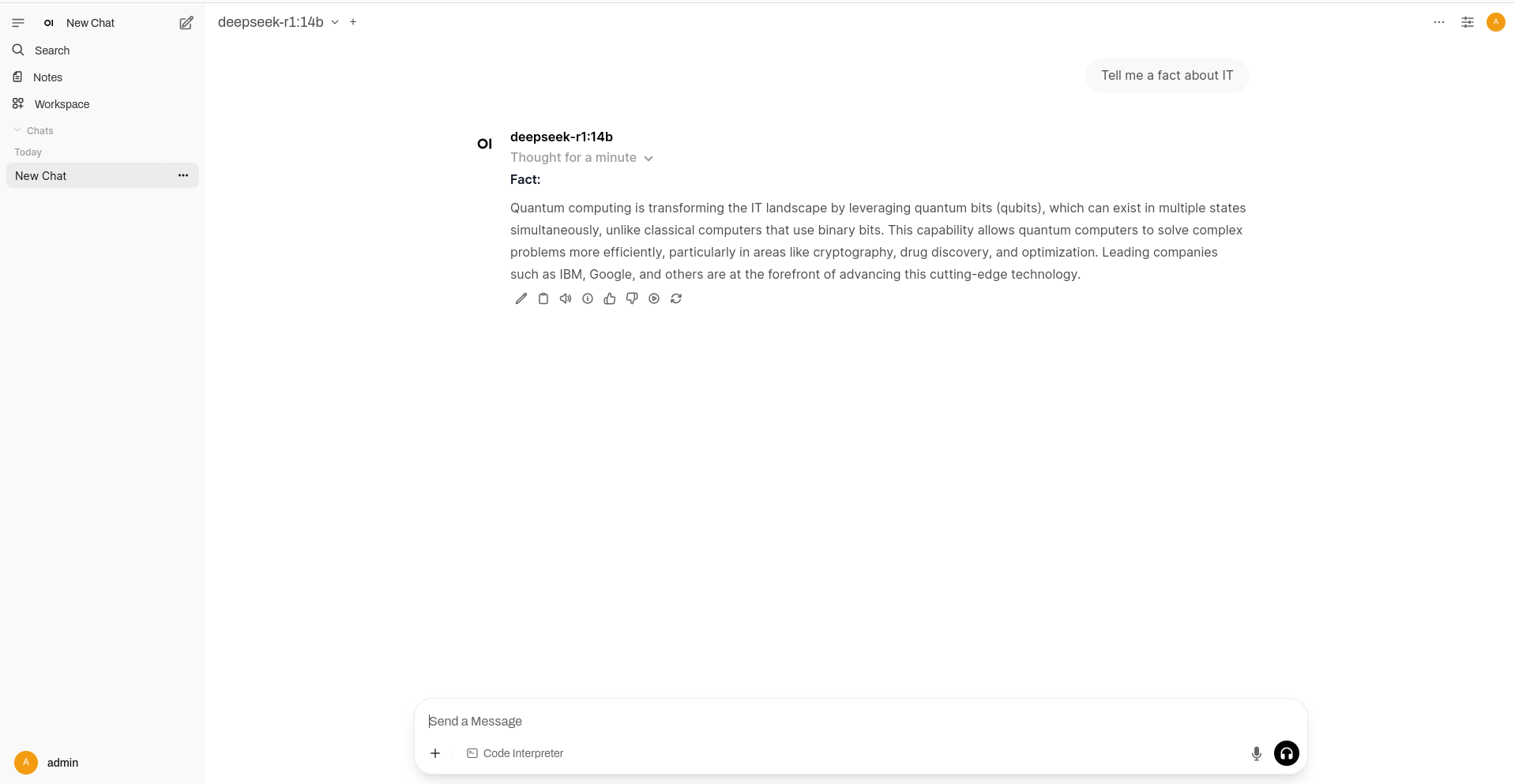

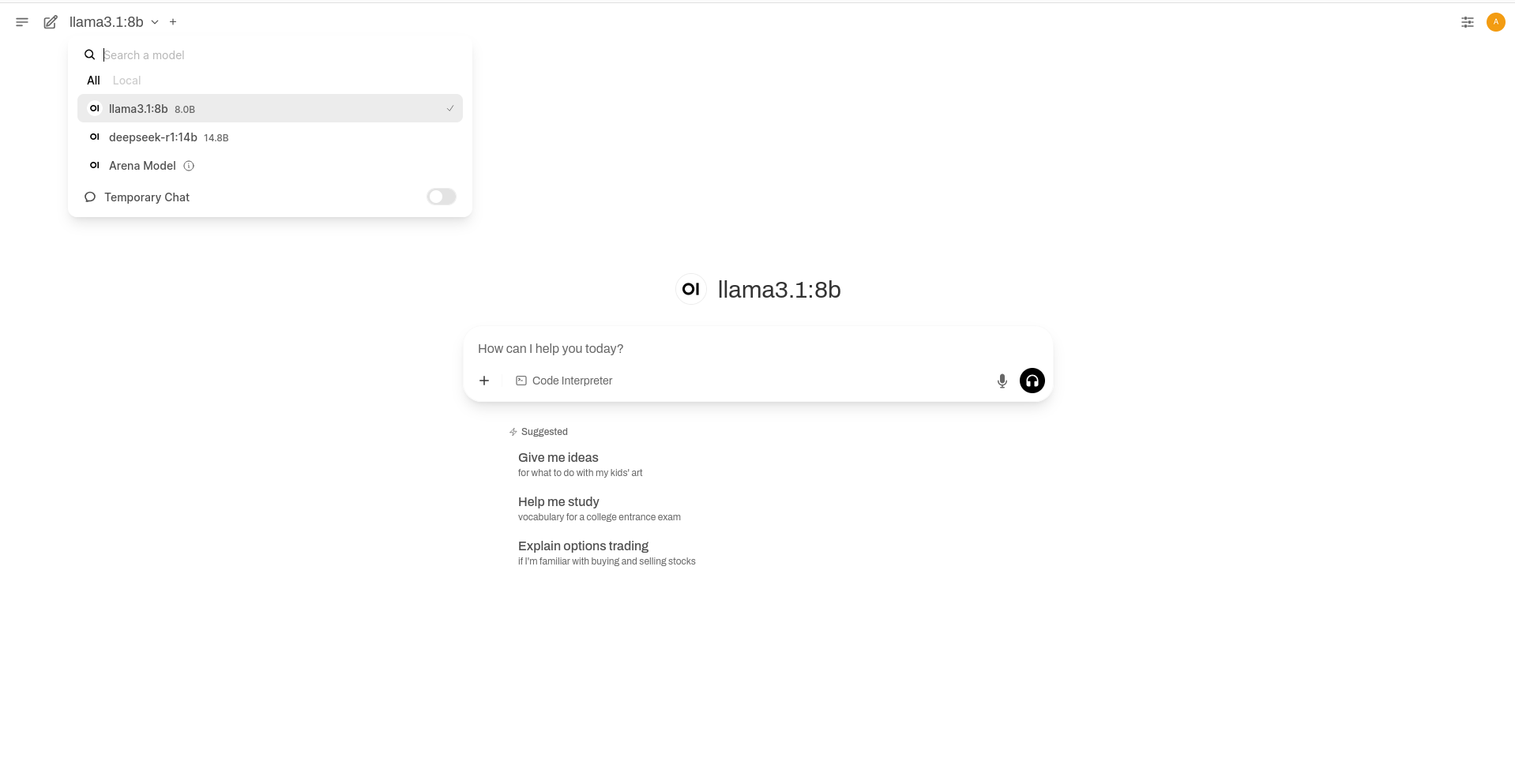

Une fois connecté, nous retrouvons bien notre vue Open WebUI et nos modèles.

Nous pouvons commencer à utiliser le modèle de notre choix.